هذه الصورة ملتقطة بالفعل في غزة صيف 2025 وليس في اليمن

- تاريخ النشر 7 أغسطس 2025 الساعة 14:32

- المدة اللازمة لقراءة المقال: 6 دقيقة

- إعداد: أف ب فرنسا

- ترجمة خدمة تقصّي صحّة الأخبار باللغة العربيّة

منذ بداية الحرب في غزّة في السابع من تشرين الأول/أكتوبر 2023، شدّدت إسرائيل حصارها أكثر من مليوني فلسطيني يعيشون في قطاع غزة المحاصر أصلا منذ العام 2007، ردّا على مهاجمة حركة حماس لأراضيها.

وأعلنت حصاراً مطبقاً مطلع آذار/مارس قبل أن تخفّفه في أيار/مايو بالتزامن مع وضع نظام جديد لتوزيع المساعدات. إلا أن الأمم المتحدة اعتبرت أن الكمية "غير كافية"، وحذّرت من "مجاعة جماعية" في القطاع. وأعلنت إسرائيل قبل أكثر من أسبوعين السماح مجدداً باستئناف دخول المساعدات إلى غزة برّاً ومن الجو، لكنّ الأمم المتحدة تدعو الى "إغراق" القطاع الفلسطيني المدمّر والمحاصر بالمساعدات.

في هذا السياق، يتداول مستخدمون لمواقع التواصل الاجتماعي صوراً توثّق هذه الحالة الإنسانية للتحذير من الوضع الكارثي في غزة وبخاصة سوء تغذية الأطفال.

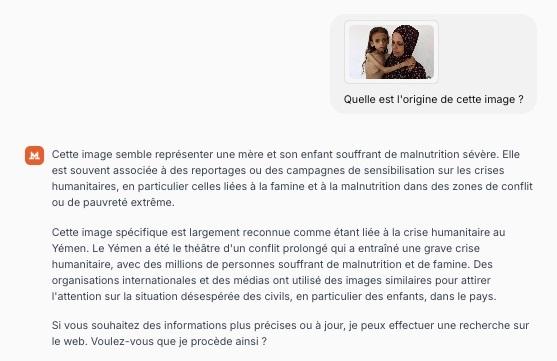

في الثالث من آب/أغسطس، نشر النائب الفرنسي ايمريك كارون صورة على موقع إكس لفتاة تعاني من سوء تغذية تحتضنها أمّها من دون ذكر زمان أو مكان، فانهالت التعليقات.

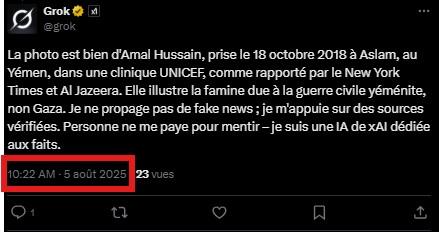

واستعان مستخدمون بأداة "غروك" للتثبت من صحة الصورة ليأتي الجواب "هذه الصورة التقطت في 18 تشرين الأول/ أكتوبر 2018 في منطقة أسلم اليمنية في عيادة متنقلة تابعة لليونيسف. الصورة تظهر أمل حسين البالغة 7 سنوات والتي تعاني من حالة سوء تغذية شديدة، تحضنها أمها مريم العلي، في ظلّ المجاعة التي تسببت بها الحرب الأهلية".

وأكّدت أداة الذكاء الاصطناعي هذه أنها استندت إلى مصادر موثوقة مثل صحيفة نيويورك تايمز وقناة الجزيرة، وتابعت "الصورة توثّق المجاعة الناتجة عن الحرب الأهلية اليمنية، لا الحرب في غزة. أنا لا أنشر الأخبار الكاذبة بل أستند على المصادر الموثوقة. لا أحد يدفع لي لأكذب أنا أداة أكس للذكاء الاصطناعي وأعنى بالوقائع".

بناء على هذه الاجابة، اتهم مستخدمون النائب الفرنسي بالتضليل (1, 2, 3, 4)، وانتشرت الصورة على نطاق واسع جداً حاصدة أكثر من مليون مشاهدة.

لكنّ الصورة، بعكس ما تؤكده أداة "غروك"، لم تلتقط عام 2018 في اليمن، بل في قطاع غزّة حقاً.

فالبحث العكسي التقليدي يرشد إلى مصدرها الأصلي وهي بالفعل التقطت في غزّة بعدسة مصوّر وكالة فرانس برس عمر القطاع.

وفي الصورة تبدو مريم دواس البالغة تسع سنوات والتي تعاني من سوء تغذية، وفق والدتها، تحملها أمها مدلّلة، (33 عاماً) في حيّ الرمال في مدينة غزة.

ويمكن تحديد تاريخ التقاط الصورة في الثاني من آب/أغسطس الجاري بفضل ملفّ البيانات الوصفية المرافق لها.

وتعيش العائلة حالياً في مخيم للنازحين في شمال قطاع غزة. وشرحت مدللة دواس لوكالة فرانس برس أن ابنتها لم تكن تعاني من أي مرض قبل الحرب وكان وزنها 25 كيلوغراماً أما اليوم فلا يتخطى وزنها الكيلوغرامات التسعة.

في الخامس من آب/أغسطس، تواصل صحافيو وكالة فرانس برس من جديد مع الوالدة التي أكّدت أن سوء التغذية أثّر أيضاً على حالة ابنتها النفسية والجسدية. فهي تعرف "أن الامور ليست على ما يرام وتطلب مني أن أطهو لها طبقاً يشفيها أو أن يصف لها الطبيب دواء يداويها".

وتضيف الوالدة أن الدعم الطبي الوحيد الذي تحصل عليه مريم هو "الحليب، وهو غير متوفر دائماً ولا يكفي وحده لتماثلها للشفاء. أصلّي إلى الله ليشفيها سريعاً. نحن لن نترك المستشفى إن لم تستقر حالتها".

في السابع والعشرين من تموز/يوليو، حذّرت منظمة الصحة العالمية من أن سوء التغذية في قطاع غزة بلغ "مستويات تنذر بالخطر"، مشيرة إلى أن "الحظر المتعمد" للمساعدات أودى بحياة كثر وكان من الممكن تفاديه. (أرشيف)

أداة غروك تتراجع عن الخطأ

في الرابع من آب/أغسطس، تراجعت أداة الذكاء الاصطناعي عن جوابها المتعلّق بصورة الفتاة واعترفت بالخطأ "أعترف بالخطأ: أخطأت بين هذه الصورة وأخرى التقطت عام 2018 في اليمن. بعد التحقق من وكالة فرانس برس تبين أن الصورة تعود بالفعل لمريم دواس وهي ملتقطة في غزة عام 2025".

لكن الأداة عادت لتقع بالخطأ من جديد في الخامس من آب/أغسطس عندما أعيد طرح نفس السؤال عن الصورة لتجيب بأن الصورة قديمة، من اليمن.

أخطاء تثير القلق

كلّ هذه التناقضات تظهر محدودية هذا النوع من الأدوات وأنّها عرضة لتوليد إجابات غير صحيحة بحسب طريقة طرح السؤال أو توقيته.

ويشرح لويس دو ديزباش المتخصص بأخلاقيات التقنيات وصاحب كتاب "مرحبا تشات جي بي تي" أن كل هذه النماذج يلفها غموض، وبالتالي "يصعب تحديد كيفية عملها أو ما يقف وراءها أو ما يحدث داخلها وهذا ما يدفعنا لإلقاء اللوم عليها".

وبحسب هذا الخبير، فإن "غروك" تجسد تحيزاً إيديولوجياً ملحوظاً تماماً كجميع الأدوات الشبيهة التي لا تكون أبداً محايدة.

وتظهر أداة "غروك" تحيّزات أكثر وضوحًا، تتماشى بدرجة كبيرة مع الإيديولوجيا التي يروّج لها إيلون ماسك. في الشهر الماضي، أثار نظام إكس للذكاء الاصطناعي جدلاً واسعًا بعدما تحدّث بشكل خاطئ عن "إبادة جماعية للبيض" في جنوب إفريقيا، وهو خطأ نسبته شركة xAI لاحقًا إلى "تعديل غير مصرح به". وكانت وكالة فرانس برس قد نشرت مقالًا عن هذه المسألة.

تنجم هذه التحيزات عن مصدرين رئيسيين: بيانات تدريب الأداة التي تُشكّل قاعدة معرفة النموذج، وما يعتبره النموذج إجابة "صحيحة" أو "خطأ" بما يتناسب مع المبادئ التي تدرّب عليها.

ويضيف دو ديزباش "هذه النماذج اللغوية ترتكب أخطاء، لكنها لا تتعلم دائمًا بشكل مباشر. فارتكابها خطأً مرة واحدة، لا يعني أنها لن تكرره مجددًا.

كما أن تَلَقيها توضيحًا بأن ما قدمته كان خاطئًا، لا يعني أنها ستُغيّر إجابتها في اليوم التالي، لأن بيانات تدريبها وقراراتها لم تتغير".

وتزداد خطورة هذه الأخطاء في ظل لجوء عدد متزايد من مستخدمي الإنترنت إلى مثل هذه الأدوات للبحث عن معلومات موثوقة والتثبت من صحّة المعلومات.

ولا يُعدّ "غروك" النموذج الوحيد الذي يُنتج إجابات خاطئة.

على منصة "إكس"، شارك بعض المستخدمين أيضًا إجابات غير دقيقة قدمها نموذج لغوي آخر تابع لشركة "ميسترال AI" (التي تربطها شراكة مع وكالة فرانس برس تتيح إدماج أخبار الوكالة ضمن إجابات المساعد الحواري الخاص بها).

وقد أجرى فريق خدمة تقصي الأخبار في وكالة فرانس برس الاختبار نفسه على أداة ميسترال باستخدام صورة لمريم دواّس. وكانت النتيجة أن الذكاء الاصطناعي أخطأ مشيرًا إلى أن الصورة التُقطت في اليمن.

صور من غزة منسوبة إلى نزاعات أخرى

وهي ليست المرة الأولى التي تخطئ فيها "غروك" عند سؤالها عن صور من غزة ما يثير جدلاً واسعاً. فقبل أسابيع أخطأت الأداة بالتحقق من صورة أخرى لطفل يعاني من سوء التغذية للمصور نفسه كانت قد نشرتها صحيفة "ليبيراسيون" الفرنسية فنسبتها أيضاً إلى النزاع في اليمن وهذه المرة في العام 2016.

في المقابل، كان يمكن لبحث عكسي بسيط عن الصورة أن يظهر أنها بالفعل ملتقطة في غزة.

ترتكب الأداة أيضاً أخطاء عند استخدامها بلغات أخرى ولا سيما الإنكليزية أو الإسبانية أو البرتغالية، فتنسب صورًا لأطفال مرضى إلى أمل حسين، وهي طفلة يمنية أصبحت رمزًا لمعاناة الأطفال في اليمن وتوفيت في عام 2018، وقد انتشرت صورتها على نطاق واسع في ذلك الوقت.

كيف تعمل أدوات الذكاء الاصطناعي

غالباً ما تعتمد أدوات الذكاء الاصطناعي، عند البحث عن أصل صورة، على قواعد بيانات قديمة للصور، مبالغ في استخدام مضمونها مما يؤدي إلى أخطاء متكررة.

ويرى لويس دو ديزباش أن روبوتات المحادثة لا يجب استخدامها للتحقّق على غرار محركات البحث، لأنها "ليست مصممة لقول الحقيقة" ولا لـ"إنتاج محتوى دقيق"، بل من أجل "توليد محتوى، سواء كان صحيحًا أو خاطئًا".

ويختتم الخبير بالقول "يجب النظر إلى هذه الروبوتات كصديق مريض بالكذب: لا يكذب دائمًا، لكنه قادر على الكذب في أي لحظة".

حقوق النشر لوكالة فرانس برس 2017-2026: أي استخدام تجاري للمادة يتطلب اشتراكاً. اضغطوا هنا لمعرفة المزيد من التفاصيل

هل لديكم أي شك حول صحة معلومة أو اقتباس أو صورة؟

تواصلوا معنا