هذا الفيديو لرفض ميلوني مصافحة نتنياهو مولّد بالذكاء الاصطناعي

- تاريخ النشر 12 مايو 2026 الساعة 14:24

- المدة اللازمة لقراءة المقال: 2 دقيقة

- إعداد: أف ب باكستان, ا ف ب الهند

- ترجمة خدمة تقصّي صحّة الأخبار باللغة العربيّة

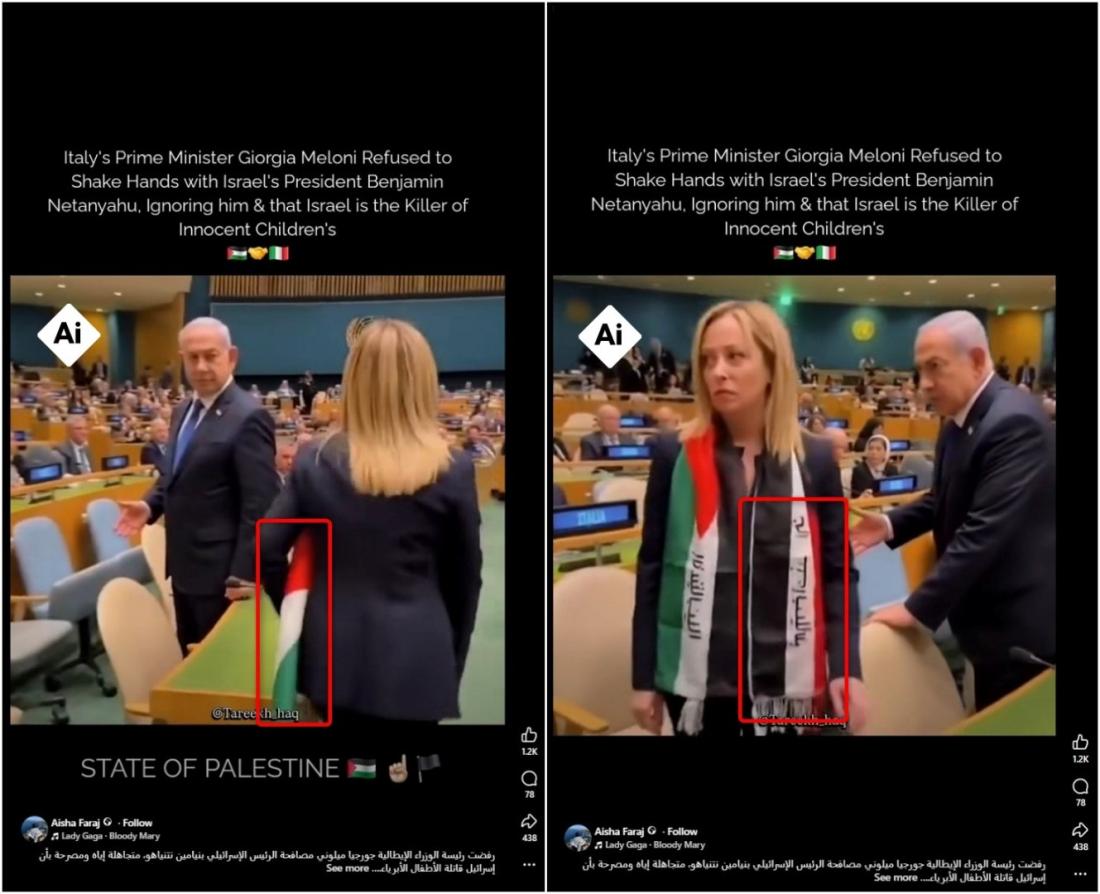

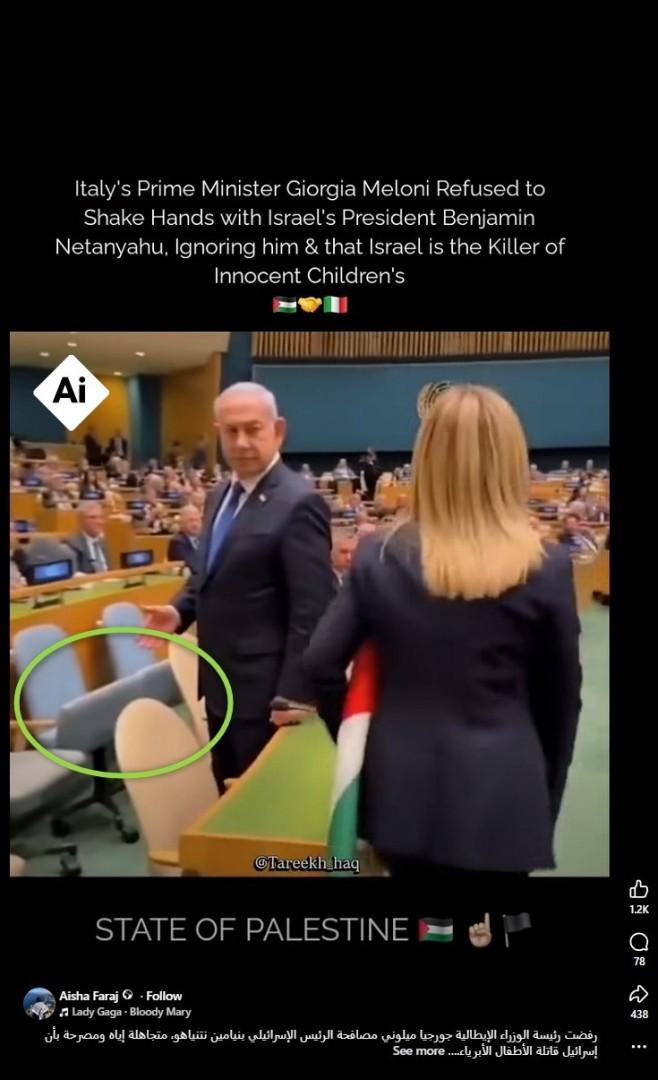

أعلنت رئيسة الوزراء الإيطالية جورجيا ميلوني الشهر الماضي تعليق اتفاقية الدفاع الإيطالية مع إسرائيل التي تتضمن تبادل المعدات العسكرية وأبحاث التكنولوجيا. في هذا السياق، تداول مستخدمون لمواقع التواصل الاجتماعي فيديو زعم ناشروه أنه لرفض ميلوني مصافحة نظيرها الإسرائيلي بنيامين نتانياهو . إلا أن المقطع في الحقيقة مولّد بالذكاء الاصطناعي.

يُظهر الفيديو ميلوني، وهي تحمل العلم الفلسطيني على كتفيها، إلى جانب نتانياهو في ما يبدو أنّه مقر الأمم المتحدة.

وجاء في التعليق المرافق "رئيسة الوزراء الإيطالية جورجيا ميلوني رفضت مصافحة بنيامين نتانياهو وصرّحت أن إسرائيل قاتلة الأطفال الأبرياء".

ويأتي انتشار الفيديو بعد أن أعلنت رئيسة الوزراء الإيطالية الشهر الماضي تعليق اتفاقية الدفاع الإيطالية مع إسرائيل التي تتضمن تبادل المعدات العسكرية وأبحاث التكنولوجيا.

وصادقت إيطاليا على الاتفاق الدفاعي عام 2006، وكان موعد انتهاء العمل به اقترب، إذ يخضع للتجديد كل خمس سنوات.

وينظّم الاتفاق التعاون بين البلدين في مجال الصناعات الدفاعية والأبحات والتكنولوجيا المعلوماتية وتدريب العسكريين، وغيرها.

وقبل تعليق الاتفاقية، تصاعد التوتر بين إيطاليا وإسرائيل بعد اتهام حكومة روما القوات الإسرائيلية بأنها أطلقت نيراناً تحذيرية على قافلة لجنود إيطاليين تابعين لقوة الأمم المتحدة الموقتة في جنوب لبنان (يونيفيل).

فيديو مولّد بالذكاء الاصطناعي

إلا أن الفيديو المتداول على أنّه لرفض ميلوني مصافحة نتانياهو هو في الحقيقة مولّد بالذكاء الاصطناعي.

ويحتوي المشهد على عناصر عدّة تثير الشكّ في صحّته منها تغيّر لون وشاح ميلوني بين لقطة وأخرى.

كما يظهر أحد الكراسي بشكل غريب.

بالإضافة إلى ذلك، يمكن ملاحظة أحرف غير مفهومة تشبه العربيّة على الوشاح وهي من العلامات التي عادة ما تدلّ أن المحتوى مولّد باستخدام الذكاء الاصطناعي.

وتشهد منصات التواصل الاجتماعي في الآونة الأخيرة انتشاراً متزايداً للصور ومقاطع الفيديو المولّدة بأدوات الذكاء الاصطناعي التي باتت متاحة للجميع.

وندّدت رئيسة الوزراء الإيطالية في 5 أيار/مايو بصور مزّيفة لها مولّدة بالذكاء الاصطناعي، واصفة منتجات تقنية "التزييف العميق" (ديبفايك) هذه بـ"الأداة الخطرة".

حقوق النشر لوكالة فرانس برس 2017-2026: أي استخدام تجاري للمادة يتطلب اشتراكاً. اضغطوا هنا لمعرفة المزيد من التفاصيل

هل لديكم أي شك حول صحة معلومة أو اقتباس أو صورة؟

تواصلوا معنا